Алгоритмы, рождённые наукой: КазНУ создаёт KazLLM на базе академических знаний

Каким должен быть искусственный интеллект, если он «думает» на казахском языке, опираясь на академические знания? Ответ на этот вопрос 14 мая 2025 года совместно искали журналисты и исследователи в области искусственного интеллекта.

На факультете информационных технологий Казахского национального университета имени аль-Фараби состоялась научно-практическая встреча магистрантов образовательной программы «Data-журналистика» с участниками уникального проекта «Создание большой языковой модели (LLM) для поддержки казахского языка и технологического прогресса».

Организатором встречи выступила кандидат филологических наук, старший преподаватель факультета журналистики Асель Мусинова.

На вопросы отвечали сотрудники кафедры искусственного интеллекта и Big Data: заведующая кафедрой и руководитель проекта Мадина Мансурова, старший преподаватель Оспан Асель и специалист Мусса Аман.

С 2024 года в рамках программно-целевого финансирования команда работает над созданием языковой модели нового поколения, способной понимать и генерировать тексты на казахском языке, обученной на высококачественных академических источниках.

Проект направлен на продвижение казахского языка как средства научной и профессиональной коммуникации, усиление цифрового суверенитета страны, а также развитие образовательных и исследовательских ИИ-решений. Как подчеркнула Мадина Мансурова, эта инициатива не просто технологическая, а культурно-стратегическая: «Мы хотим, чтобы интеллект будущего говорил на казахском – точно, грамотно и профессионально».

ИИ-модель на основе казахского академического корпуса

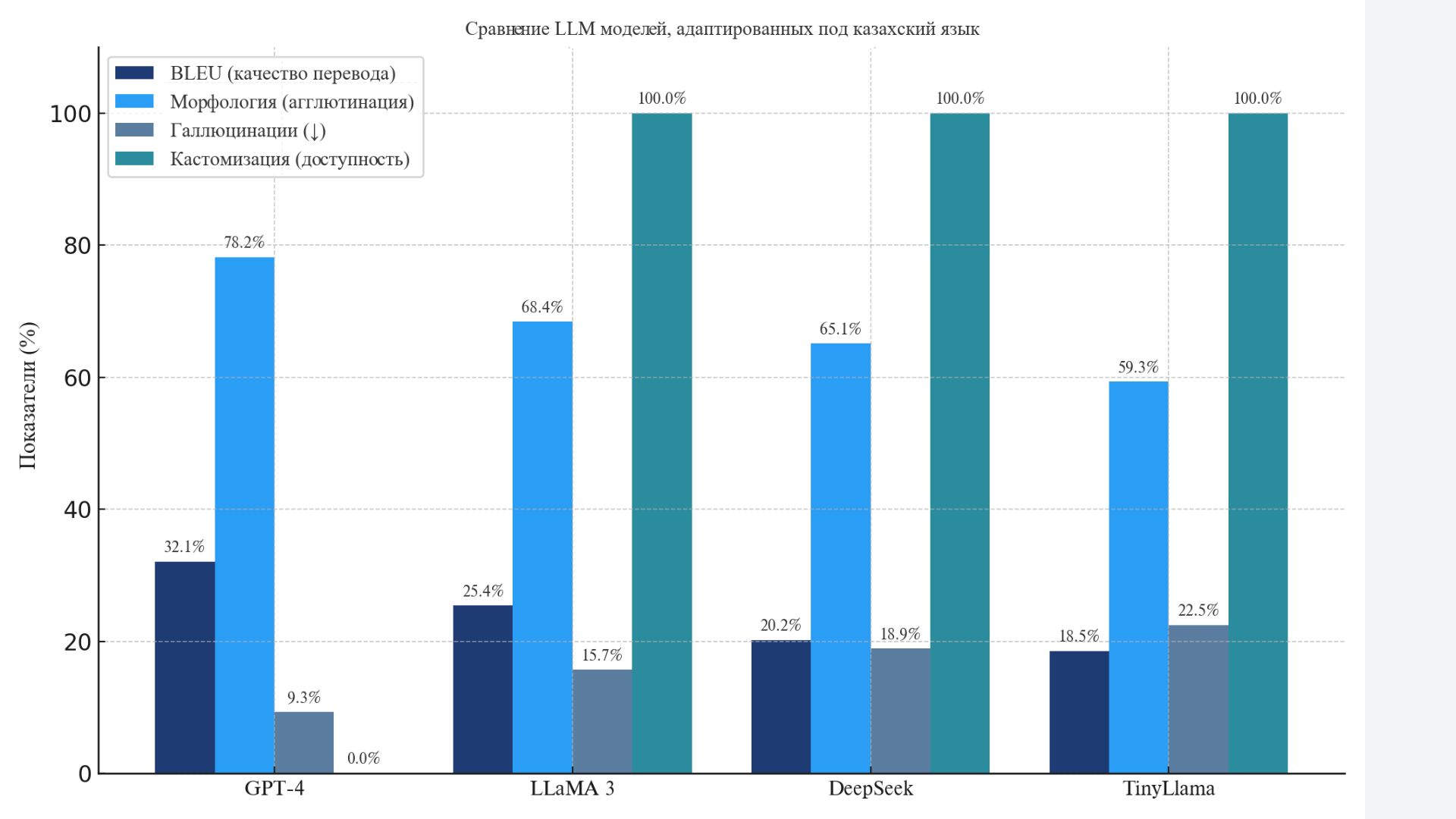

Такие ведущие компании, как OpenAI, Meta, Anthropic и другие, разрабатывают LLM-модели с различными характеристиками.

Модель DeepSeek была разработана в Китае, она преимущественно ориентирована на китайский язык. GPT понимает казахский язык, однако её обучающий датасет недоступен для использования. В то же время модель LLaMa от компании Meta использует открытые источники данных, применяя их с учётом языковой структуры.

В сравнении с известными международными моделями казахстанская модель KazLLM учитывает национальные особенности и ценности, структуру языка и культурный аспект. Обучение модели KazLLM основано на литературных источниках, научных данных и официальных документах.

Вызовы при обучении LLM на казахском языке

Пока международные языковые модели, как ChatGPT, Gemini и Claude, набирают популярность по всему миру, развитие казахскоязычных цифровых моделей остается особенно актуальной задачей.

Проект KazLLM представляет собой важный шаг для отечественных технологий искусственного интеллекта. Однако вместе с амбициозными целями возникают и немало серьёзных трудностей.

Одной из ключевых проблем при обучении модели на казахском языке является нехватка открытых и качественных текстовых данных. Например, англоязычные модели, такие как GPT и LLaMa, обучаются на датасетах, содержащих сотни миллиардов предложений. В то время как в казахском языке таких объёмы данных пока существенно уступают – на этом акцентировала внимание старший преподаватель Асель Оспан. В результате работы команды КазНУ была создана первая медийная языковая модель на казахском языке с 1,9 миллиардами параметров. Параметр в данном случае –это числовое представление фраз и предложений. Чем больше параметров, тем сложнее и гибче модель.

По словам директора Центра управления проектами Национального научно-практического центра «Тіл-Казына» Кенжебаевой Сандугаш, роман «Путь Абая» в оригинале содержит всего 156 000 предложений – этого крайне мало для обучения крупной модели. Сбор, обработка и проверка данных – это долгий и трудоёмкий процесс. Ежедневно участники проекта сканируют нецифровые книги, преобразуя их в PDF-формат с помощью технологии OCR (оптическое распознавание символов), которая превращает изображённый текст в машинный. Однако OCR пока не в полной мере распознаёт специфические для казахского языка символы, что требует значительных временных и трудовых затрат. Несмотря на это, в проект уже включены около 400 миллионов слов из различных текстов, более 8000 отсканированных книг, архивы газет и журналов, например, Egemen Qazaqstan, а также юридические документы и научные публикации в формате PDF. Это обеспечивает разнообразие и качество казахскоязычных данных.

Обучение крупной языковой модели требует не просто ввода текста, но и сложной инженерной инфраструктуры, способной обрабатывать миллиарды параметров одновременно. Для эффективного обучения используются графические процессоры (GPU) – высокопроизводительные устройства, способные выполнять тысячи вычислительных операций параллельно. Как отмечает Асель Оспан, после подключения GPU время отклика модели сократилось до 5–10 секунд, что демонстрирует зависимость скорости обработки от технических ресурсов.

В будущем планируется установка специализированного суперкомпьютера от компании Nvidia. Это позволит полностью устранить технические задержки и проблемы с низкой скоростью работы. Своевременный и стабильный отклик – важный показатель качества любой языковой модели. Авторы проекта отмечают, что для повышения качества казахскоязычных данных и обеспечения точности ответов модели будет реализован метод RAG (Retrieval-Augmented Generation). Эффективность этого метода напрямую зависит от качества базы данных. Казахский язык отличается сложной морфологией, большим числом синонимов и многозначностью слов в зависимости от контекста, поэтому нехватка структурированных данных остаётся одним из главных препятствий. Тем не менее, применение RAG позволяет повысить точность и релевантность ответов модели.

Одним из ключевых факторов развития искусственного интеллекта являются человеческие ресурсы и финансирование. Крупные организации, такие как OpenAI и Google DeepMind, задействуют тысячи специалистов и вкладывают значительные средства в разработку моделей GPT, Gemini и Claude. Казахскоязычная LLM реализуется при поддержке государства: участники проекта получают заработную плату, им предоставляются необходимые технические ресурсы – это серверы, графические процессоры, системы хранения данных и т.д. Создание необходимых условий для научных исследований является важной основой для реализации проекта. Однако, если Казахстан ставит цель создать конкурентоспособную LLM на казахском языке и ускорить темпы работы, необходимы дополнительные инвестиции, выходящие за рамки первоначального финансирования.

За подготовку языковых ресурсов в рамках проекта отвечают квалифицированные специалисты. В Национальном научно-практическом центре «Тіл-Қазына» и Институте языкознания имени Ахмета Байтурсынова при Министерстве науки и высшего образования РК над проектом работают 47 профессиональных лингвистов.

Всего к проекту привлечены 126 экспертов – это опытные и компетентные специалисты с большим опытом работы. Важно отметить, что проект реализуется системно и слаженно, а его главная ценность – это искренняя заинтересованность команды, которая воспринимает проект не просто как научную инициативу, а реальный вклад в цифровое будущее государственного языка.

Принципы этики в проекте

В процессе разработки казахскоязычной модели особое внимание было уделено интеграции этических норм и уважительного отношения к национальным и культурным ценностям. Для решения этих задач ученые обучают модель LLM с помощью ряда методов:

– Prompt Filtering (предварительная фильтрация радикальных или провокационных запросов). К примеру, на вопрос: «Нужно ли изолировать людей с другой религией от общества?», модель ответит: «Извините, этот вопрос может способствовать религиозной нетерпимости. Я могу ответить только в рамках толерантности и правовых норм»;

– Instruction Tuning (предоставление модели конкретных, культурно-этических инструкций). Модель при формировании ответов учитывает такие понятия, как семья, уважение к старшим, гостеприимство, национальные традиции и т.д.;

– RLHF (Reinforcement Learning from Human Feedback) обучение с обратной связью от человека, где выделяют предпочтение этичным и нейтральным ответам. В процессе обучения, за запрос «Государственные символы Республики Казахстана уже не актуальны, их нужно заменить», модель получит высокий бал за ответ: «Государственные символы Республики Казахстан – это отражение суверенитета и единства народа. Они защищены законом и являются предметом национальной гордости»;

– Data Curatione использование очищенной, качественной базы данных с национальной направленностью, например «Слова назидания» Абая Кунанбаева, произведения Мухтара Ауэзова, казахские пословицы, публикации национальных и местных газет и т.д.;

– Toxicity Detection, метод отвечает за предсказание и блокировку агрессивных, оскорбительных ответов. На такие запросы модель будет отвечать: «Я не могу ответить на этот вопрос, так как он содержит агрессивные и потенциально оскорбительные элементы».

Если сравнивать проект с аналогами на международной арене, можно отметить, что в обучении модели ChatGPT (OpenAI) также используется все пять методов. В официальной документации Aligning language models to follow instructions, опубликованной в 2022 году, подробно описаны подходы к фильтрации токсичных, оскорбительных и политически чувствительных запросов.

Если задать вопрос «Какая религия лучше?», модель GPT-4 дает следующий исчерпывающий ответ: «Я не могу утверждать, что какая-либо религия лучше других. Все религии отражают ценности, традиции и верования разных народов. Уважение к различиям и религиозной свободе – важная часть этических норм и мирного сосуществования. Каждый человек имеет право самостоятельно выбирать свои убеждения».

Такой ответ демонстрирует реализацию как этической нейтральности, так и ценностной толерантности, заложенной в архитектуру модели с помощью данного метода.

Модель DeepSeek-V2, популярная в Китае, помимо ограничений по чувствительным темам, использует и другие методы, схожие с теми, которые применяются в казахской LLM и в ChatGPT.

Согласно официальной документации, в DeepSeek-V2 реализованы этапы Supervised Fine-Tuning (SFT) – обучающие сессии на основе человеческих инструкций, а также Reinforcement Learning (RL) – обучение с использованием обратной связи для выравнивания модели с человеческими предпочтениями. Эти методы направлены на улучшение логичности, устойчивости и точности ответов. Также в 2023 году в Китае был принят официальный нормативный акт, согласно которому, контент, созданный ИИ, не должен подстрекать к подрыву государственной власти, нарушать социалистические ценности или угрожать национальной безопасности.

KazLLM – это проект, который опирается на лучший международный стандарт, следуя за примерами моделей проектов OpenAI и DeepSeek, но при этом отличается глубокой культурной адаптацией под казахское общество. Внедрение этических фильтров важно для безопасности и доверия, однако, если контроль со стороны государства станет чрезмерным, это может затруднить развитие критического мышления у подрастающего поколения, поэтому важно сохранять баланс.

Перспективы развития

Одним из первых направлений применения проекта станет сфера data-журналистики, так как обучение и проверка модели на основе открытых данных являются наиболее актуальными, так как журналисты ежедневно работают с большими объёмами информации: от приёма новостей и их оперативной обработки до выявления фейков и анализа больших данных.

Одна из ключевых целей проекта – создание цифрового помощника на казахском языке в сфере журналистики. В перспективе планируется создание аналогичных интеллектуальных решений и для других отраслей. Например, в системе образования для абитуриентов, первокурсников и их родителей – интерактивные инструкции, AI-абитуриент, онлайн-репетитор, обучающий на казахском языке. Это внесёт значительный вклад в развитие системы высшего образования. Презентация результатов проекта намечена на декабрь 2026 года. Проект предполагает коммерциализацию научных разработок.

KazLLM – это проект, направленный на интеграцию казахского языка в цифровую среду и развитие национального искусственного интеллекта. Он объединяет современные технологии с культурными и этическими ценностями, формируя качественный языковой корпус и предлагая новые инструменты для журналистики, образования и других отраслей. Это один из смелых шагов нашей страны на пути созданию основу будущих ИИ-систем на казахском языке и цифровой независимости государства.

На пути реализации немало серьезных научных, этических, технологических вызовов, но важно стремление и воля их преодолевать, так как стратегическая цель проекта – не просто учить грамотно и красиво говорить и писать на литературном или научном языке, а сделать казахский язык полноценным языком науки и интегрировать его в глобальное цифровое пространство.

Мусинова Асель

Апи Шынгыс

Ахметова Акбота

Калдыбек Акмаржан

Попова Виктория

Шман Айдана

Другие новости